Como Treinar um Gerador de Imagens por IA em 2026

Última atualização: 2026-01-22 18:08:26

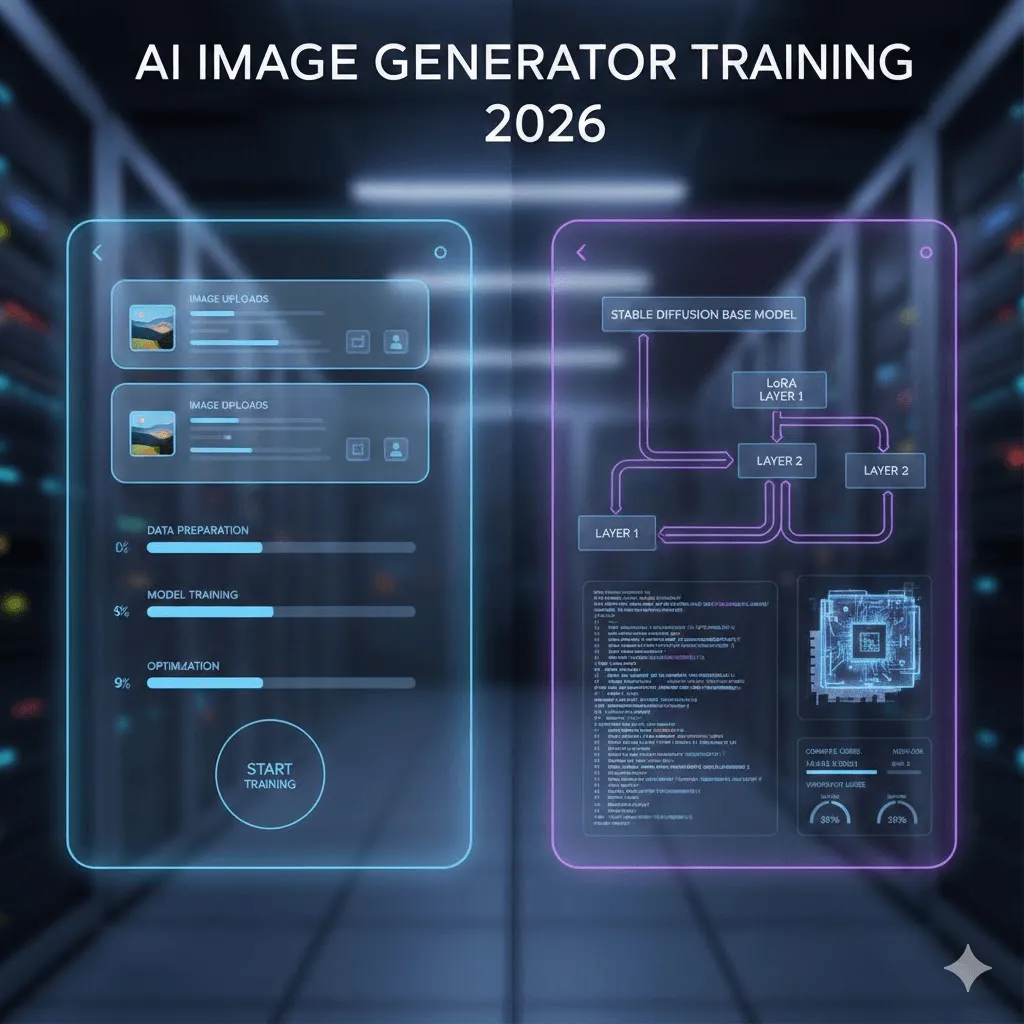

Em 2026, treinar um gerador de imagens por IA deixou de ser uma competência restrita ao campo da pesquisa: o que antes exigia conhecimentos profundos de machine learning, GPUs de alto custo e semanas de experimentação, hoje pode ser realizado em menos de uma hora — ou até em apenas 20 minutos — bastando escolher a abordagem correta.

É importante notar, entretanto, que as metodologias de treinamento de IA variam significativamente: enquanto algumas opções são rápidas e acessíveis, porém limitadas, outras oferecem controle total sob uma curva técnica mais acentuada. Este guia detalha ambas as abordagens com clareza, fundamentando-se no que é efetivamente funcional na atualidade, sem se prender a promessas de marketing ou tutoriais obsoletos.

Este guia explora detalhadamente ambas as abordagens: desde a opção sem código, que permite treinar um modelo em apenas 20 minutos por cerca de US$ 3, até a via técnica, ideal para quem deseja dominar DreamBooth, LoRA e scripts personalizados. Apresentamos uma análise honesta sobre o que realmente funciona e os pontos de dificuldade habituais, garantindo que você supere os obstáculos técnicos com base em nossa experiência prática.

Acesso Rápido

Se o seu objetivo é treinar um modelo com sua própria imagem para gerar fotos personalizadas por IA, avance diretamente para a Seção 3 e acompanhe o tutorial do Replicate.

Para desenvolvedores que buscam controle total e autonomia técnica, recomendamos iniciar diretamente na Seção 4, onde detalhamos os processos de treinamento especializado.

Caso ainda não tenha decidido qual abordagem adotar, continue a leitura para descobrir a solução ideal para o seu projeto.

1. O que significa, na prática, o treinamento de modelos de IA?

Para dissipar qualquer confusão inicial, é fundamental esclarecer que, ao falarmos em "treinar um gerador de imagens por IA", raramente nos referimos à criação de um modelo do zero, visto que tal processo exigiria investimentos de centenas de milhares de dólares e uma infraestrutura robusta de data centers.

Na prática, o processo consiste no ajuste fino de um modelo já existente: como o Stable Diffusion já domina a criação de pessoas, produtos e estilos artísticos, o seu papel é apenas ensiná-lo a reconhecer as particularidades do seu objeto, pessoa ou estética visual específica através de uma seleção de 10 a 50 imagens de referência.

O que você pode treinar: exemplos práticos e reais

Pessoas e Personagens: Ao treinar um modelo com apenas 18 fotografias pessoais, é possível gerar imagens em qualquer contexto — seja surfando, vestindo um traje social ou transformado em um personagem de animação. Como o sistema assimila com precisão todos os traços faciais, basta utilizar uma palavra-chave específica ("ohw person") para ativar e aplicar sua identidade visual a diferentes cenários.

Produtos: Amplamente adotada por marcas de e-commerce, esta tecnologia permite o treinamento de modelos a partir de apenas 20 fotos de diferentes ângulos, possibilitando a geração ilimitada de imagens de marketing em cenários diversos com um custo significativamente inferior ao de sessões fotográficas tradicionais.

Estilos Artísticos: Esta é uma funcionalidade fascinante: ao fornecer cerca de 30 imagens do seu estilo autoral, o modelo passará a replicar essa estética em novos temas, permitindo que estúdios escalem sua identidade visual com total consistência.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

2. Duas Abordagens: Escolha a Opção Ideal para o Seu Cenário

A realidade é que a maioria dos usuários deve iniciar sua jornada em plataformas sem código, pois, embora a abordagem manual seja comum no desenvolvimento, essas ferramentas entregam 90% dos resultados com apenas uma fração do esforço, sendo a escolha ideal exceto para quem exige parâmetros de treinamento específicos ou deseja dominar a tecnologia subjacente.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

Critério de comparação | Plataformas sem código (No-Code) | Abordagem Técnica |

Tempo para o primeiro resultado | Entre 15 e 30 minutos | De 3 a 8 horas, incluindo configuração e treino |

Custo inicial estimado | US$ 2 a 10 por modelo criado | Grátis via GPU local ou US$ 0,50 a 5 em nuvem |

Requisitos de conhecimento | Inexistentes; basta realizar o upload das fotos | Python, linha de comando e conceitos de GPU |

Teto de qualidade | Excepcional, atingindo 90% de fidelidade | Potencial superior mediante ajustes manuais finos |

Indicação de uso | Ideal para resultados imediatos e poucos modelos (1 a 5) | Criação em escala (50+ modelos), controle total ou estudo de ML |

3. O Caminho Mais Rápido: Treinamento em Plataformas Sem Código

Após avaliarmos cinco plataformas distintas, apresentamos as soluções que realmente entregaram resultados práticos e eficazes.

Replicate: o ponto de partida ideal e a ferramenta que utilizei para começar

Com um investimento de aproximadamente US$ 2,50 por sessão de treinamento, o custo por imagem gerada é de apenas US$ 0,03.

O tempo estimado para a conclusão do treinamento varia entre 18 e 25 minutos.

Por que escolher o Replicate? A plataforma destaca-se por oferecer a melhor relação entre custo e qualidade do mercado, apresentando uma interface intuitiva que prioriza a eficiência: basta carregar as imagens para concluir o treinamento de forma direta. Além disso, sua documentação é excepcionalmente clara e acessível, facilitando o processo do início ao fim.

Guia passo a passo: O processo real, para além da versão de marketing

Preparação das Suas Imagens:

Ao utilizar 18 fotografias pessoais para este processo, ficou evidente que a diversidade do conjunto de dados é muito mais crucial do que a quantidade bruta de imagens. Enquanto uma tentativa inicial com 30 retratos similares limitou o modelo à memorização de poses específicas, a utilização de 18 imagens variadas — abrangendo diferentes ângulos, condições de iluminação e planos de corpo inteiro — garantiu resultados significativamente mais precisos e flexíveis.

Embora o requisito mínimo seja de 512×512 pixels, recomenda-se a utilização de imagens em 1024×1024 para obter resultados superiores, garantindo sempre a máxima nitidez, já que a inteligência artificial não consegue processar informações que não estejam visíveis com clareza. É fundamental evitar o uso de filtros pesados ou aplicativos de suavização facial, assegurando que o modelo aprenda seus traços autênticos em vez de basear-se em versões artificialmente modificadas.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

O Processo de Upload:

Para começar, acesse o site replicate.com e realize o seu cadastro — observando que a inserção de dados de pagamento é obrigatória mesmo para o plano gratuito — e navegue até a seção de treinamento. O upload das imagens pode ser feito individualmente ou através de um arquivo ZIP, sendo este o método mais ágil e recomendado para processar conjuntos com mais de 10 arquivos simultaneamente.

A palavra de ativação (um detalhe fundamental):

Para garantir resultados precisos, utilize um identificador exclusivo e pouco comum, como "ohw person", evitando termos genéricos como "john" ou "photo" que já fazem parte da base de treinamento do modelo. Alternativas como "zxc person" funcionam perfeitamente e, graças à automação da plataforma que gera legendas a partir desses gatilhos, você elimina a necessidade de rotular cada imagem manualmente.

Configurações de Treinamento:

Para a maioria dos projetos, as configurações padrão mostram-se ideais, como as cerca de 800 etapas de treinamento sugeridas pelo Replicate; embora seja possível customizar esses valores, iniciar com o padrão é o caminho mais seguro. Caso note sinais de "overfitting" — quando o modelo replica as fotos originais de forma excessivamente literal —, tente reduzir o treinamento para uma faixa entre 500 e 600 etapas em sua próxima iteração.

A dinâmica da espera:

O treinamento das 18 imagens foi concluído em aproximadamente 22 minutos e, assim que o processamento finalizar, você receberá uma notificação automática por e-mail. Vale observar que a barra de progresso tende a ser otimista, de modo que uma estimativa de cinco minutos restantes geralmente representa cerca de dez minutos de espera real.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

Como testar e validar o seu modelo:

Esta é a fase em que a criatividade assume o controle: comece com comandos simples, como "a photo of ohw person smiling", utilizando sua palavra de ativação e, após validar os resultados iniciais, explore composições mais elaboradas, que podem variar de representações heroicas a retratos profissionais em trajes corporativos.

Dica de especialista: maximize a qualidade das suas gerações utilizando prompts negativos com termos como "blurry, low quality, deformed, distorted", uma prática que refina drasticamente os resultados ao mitigar a ocorrência de artefatos visuais e distorções anatômicas indesejadas.

Outras plataformas de destaque que merecem sua atenção

Apesar de testadas, estas alternativas mostram-se mais adequadas para cenários e casos de uso específicos:

getimg.ai: Embora apresente um custo mais elevado (entre US$ 8 e US$ 10 por modelo), a plataforma compensa o investimento com uma interface intuitiva e suporte ao treinamento FLUX.1, entregando resultados visivelmente superiores em cenas complexas — a escolha ideal para quem atua em nível profissional.

Leonardo.Ai: Especialmente voltado para desenvolvedores de jogos e artistas conceituais, o Leonardo.Ai oferece um plano gratuito para experimentação e, embora sua interface seja mais densa que a do Replicate, a qualidade do treinamento é sólida e consistente.

ImagineArt: Com processos de treinamento ágeis realizados em menos de 15 minutos, a plataforma agora integra geração de vídeo para permitir a animação de personagens personalizados, revelando-se uma funcionalidade promissora que ainda estamos avaliando minuciosamente.

4. A Abordagem Técnica: O Treinamento com Stable Diffusion

Se você optou por seguir a abordagem mais técnica e complexa, consolidamos aqui os conhecimentos essenciais que teriam evitado horas de depuração de erros de CUDA em nossas experiências anteriores.

Por que investir no treinamento técnico de modelos?

Sejamos realistas: embora este recurso não seja necessário para todos os perfis, existem razões estratégicas e legítimas que tornam a sua utilização indispensável em cenários específicos:

Ao gerenciar o treinamento de dezenas ou centenas de modelos, os custos acumulados de soluções sem código podem impactar significativamente o seu orçamento.

Tenha acesso aos parâmetros de treinamento avançados que as plataformas convencionais costumam ocultar.

Trabalhe com total segurança utilizando dados proprietários que exigem permanência absoluta em sua própria infraestrutura.

Compreender profundamente o funcionamento desta tecnologia é um objetivo legítimo e fundamental para quem busca o domínio técnico.

As três principais abordagens

DreamBooth: Desenvolvido pelo Google, este método permite o ensino de novos conceitos ao modelo através de um identificador exclusivo e um conjunto reduzido de imagens. Embora a pesquisa original demonstre eficácia com apenas 3 a 5 fotos, a utilização de 15 a 20 imagens é recomendada na prática para garantir resultados mais consistentes e precisos, especialmente ao trabalhar com pessoas ou objetos específicos.

LoRA (Low Rank Adaptation): Representando uma verdadeira revolução tecnológica, o LoRA evita a modificação de arquivos massivos de até 7 GB ao criar "adaptadores" compactos de apenas 3 a 50 MB. Além de permitir um treinamento de 3 a 5 vezes mais veloz em GPUs domésticas convencionais, esta técnica garante uma qualidade final praticamente indistinguível do ajuste fino completo.

Recomendada para 95% dos usuários técnicos, a combinação entre DreamBooth e LoRA destaca-se por atingir o equilíbrio ideal entre performance e qualidade.

Ajuste Fino Completo: Este método consiste no treinamento integral do modelo e exige hardware de alto desempenho, com no mínimo 24GB de VRAM. Contudo, exceto em casos muito específicos, o LoRA entrega cerca de 95% da qualidade final utilizando apenas 10% dos recursos; na prática, mesmo após seis horas de processamento em uma GPU A100, os resultados obtidos não apresentam melhorias significativas em relação à eficiência proporcionada pelo LoRA.

Requisitos essenciais e tudo o que você precisa para começar

Hardware: O que você realmente precisa para garantir a performance ideal

O requisito mínimo para operação é uma GPU NVIDIA com 12GB de VRAM, sendo que modelos como a RTX 3060 processam o treinamento LoRA em aproximadamente 45 minutos; contudo, para atingir o desempenho ideal em ambiente local, recomenda-se o uso de uma RTX 4070 ou 3080 com 16GB.

Caso não disponha de uma GPU própria, soluções em nuvem como RunPod ou vast.ai permitem realizar treinamentos com investimentos entre US$ 0,50 e US$ 2 por sessão, enquanto o Google Colab Pro oferece acesso ilimitado por US$ 10 mensais, ainda que sujeito a filas de espera em períodos de alta demanda.

Software:

Utilize o Python 3.10 ou superior, evitando a versão 3.11 devido a instabilidades de compatibilidade identificadas.

PyTorch com suporte nativo para aceleração CUDA

A biblioteca Diffusers da Hugging Face

Integração avançada com as bibliotecas accelerate e transformers, utilizando peft para o ajuste fino de modelos LoRA.

O Processo de Treinamento na Prática (DreamBooth + LoRA)

Considerando que você provavelmente já domina a instalação de pacotes via pip e a configuração inicial de ambientes Python, avançaremos diretamente para os componentes essenciais que realmente impactam o desempenho do modelo.

Instalação simplificada: utilize este comando de linha única que realmente funciona:

pip install diffusers[torch] transformers accelerate peft bitsandbytes

Script de Treinamento:

Para simplificar o processo e evitar extensos blocos de código, recomendamos a utilização do script oficial de treinamento disponível no repositório "diffusers" da Hugging Face, uma solução robusta, constantemente atualizada e de alta confiabilidade. A seguir, destacamos os parâmetros fundamentais para configurar o seu modelo com sucesso:

Taxa de aprendizado: O valor de 1e~4 representa o equilíbrio ideal para o treinamento, visto que taxas de 1e~5 resultam em um processo excessivamente lento e valores como 5e~4 comprometem a estabilidade do modelo.

Etapas de treinamento: Na maioria dos casos, recomenda-se configurar entre 800 e 1000 etapas, garantindo o equilíbrio ideal para que o modelo aprenda o conteúdo necessário sem correr o risco de overfitting.

Batch size: Recomenda-se utilizar o valor 1 ou 2, uma vez que as limitações habituais de hardware da GPU restringem o processamento de volumes maiores durante o treinamento com LoRA.

LoRA rank: Recomenda-se a utilização de valores entre 16 e 32, considerando que ranks mais elevados proporcionam maior capacidade de detalhamento em troca de um processamento mais lento. Enquanto o ajuste em 16 apresenta ótimos resultados para fisionomias, o valor 32 é ideal para capturar a complexidade de estilos artísticos elaborados.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

Veja a seguir o comando exato utilizado nesta execução:

accelerate launch train_dreambooth_lora_sdxl.py \

pretrained_model_name_or_path="stabilityai/stable diffusion xl base 1.0" \

instance_data_dir="./minhas_imagens_de_treinamento" \

instance_prompt="uma foto da pessoa sks" \

resolução=1024 \

train_batch_size=1 \

taxa_de_aprendizado=1e 4 \

max_train_steps=800 \

use_lora \

lora_r=16 \

output_dir="./output_lora"

Este processo levou 38 minutos em uma RTX 3060, sendo que o tempo estimado cai para menos de 15 minutos em uma RTX 4090 ou ultrapassa os 90 minutos ao utilizar a GPU T4 gratuita do Google Colab.

5. Preparação do Dataset: O fator determinante para o sucesso do seu modelo

Apresentamos esta seção com prioridade máxima por ser o pilar fundamental do processo; enquanto a maioria dos guias negligencia este ponto, a qualidade do seu treinamento é determinada em 80% pela curadoria do conjunto de dados e em apenas 20% pelas configurações aplicadas.

As diretrizes fundamentais validadas por testes práticos

A quantidade ideal situa-se entre 15 e 25 imagens. Embora volumes de 5 a 10 arquivos sejam frequentemente sugeridos, essa contagem raramente é suficiente para resultados complexos, enquanto o uso de 40 ou mais imagens tende a não oferecer ganhos reais de qualidade, apenas prolongando desnecessariamente o tempo de processamento.

A importância da resolução: para garantir a máxima eficiência no treinamento, é essencial utilizar dimensões de ao menos 512×512 no SD 1.5 e 1024×1024 no SDXL, redimensionando fotos de alta resolução nativa (como 4000×3000) antes de iniciar o processo.

A variedade é mais crucial que a quantidade: este princípio fundamental dita que 15 imagens diversificadas superam 30 registros similares. Para otimizar o treinamento, utilize diferentes ângulos, iluminações e contextos; no caso de modelos humanos, inclua desde close-ups a planos de corpo inteiro, abrangendo também variadas expressões e vestimentas.

Erros frequentes na preparação de datasets: lições aprendidas com as minhas próprias falhas

Uso de imagens filtradas ou editadas: Evite fotos com filtros de redes sociais, modo beleza ou edições pesadas, pois isso fará com que o modelo assimile as características do filtro em vez de aprender os traços reais do objeto ou pessoa.

Iluminação inconsistente: Embora uma leve variação seja positiva, contrastes extremos — como alternar entre a luz solar intensa e ambientes internos mal iluminados — tendem a confundir o modelo, prejudicando a qualidade final do treinamento.

Presença de várias pessoas: Ao treinar o modelo com base em sua própria imagem, certifique-se de remover terceiros da moldura para evitar a mistura de características físicas, prevenindo que a IA replique elementos indesejados, como penteados de outras pessoas que apareçam em apenas uma fração das fotos utilizadas.

Marcas d'água e textos: Para evitar que o modelo incorpore elementos indesejados, certifique-se de removê-los ou recortá-los das imagens de treinamento.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

6. Detalhamento dos custos reais

Em relação ao investimento necessário, apresentamos a seguir o detalhamento dos custos reais envolvidos em todos os nossos testes.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.

Serviço | Treinamento | Custo por imagem | Avaliação |

Replicate | $2,47 | $0,028 | Melhor custo-benefício |

getimg.ai | $8,00 | $0,05 a $0,08 | Investimento ideal para o modelo FLUX |

Leonardo.Ai | Gratuito a $10 | Variável | Excelente para experimentação |

Google Colab Pro | $10/mês ilimitado | $0 | Recomendado para larga escala (10+ modelos) |

RunPod (RTX 3090) | ~$0,80 | $0 (hospedagem própria) | Equilíbrio ideal para desenvolvedores |

GPU Local | ~$0,15 (eletricidade) | $0 | A melhor escolha para quem possui hardware próprio. |

7. Resolução de problemas: Como identificar e superar os desafios mais comuns

Apresentamos aqui os desafios reais encontrados e as respectivas soluções aplicadas, permitindo que você otimize seu fluxo de trabalho e evite as dificuldades mais comuns do processo.

O problema da replicação excessiva: quando o modelo limita-se a copiar as fotos de treinamento

Esse fenômeno é conhecido como overfitting, ocorrendo quando o modelo replica os dados de treinamento de forma tão literal que, ao solicitar "sks person at the beach", o resultado acaba sendo apenas uma reprodução da sua foto original inserida em um cenário de praia.

Estratégias que se mostraram eficazes:

Ao reduzir o número de passos de treinamento de 1000 para 600, notamos uma melhora imediata na performance, pois o modelo deixou de apenas memorizar os dados para passar a generalizá-los com eficiência. Essa evolução foi ainda mais potencializada pela inclusão de uma maior variedade no conjunto de treinamento, o que refinou consideravelmente os resultados obtidos.

O Problema da Inconsistência em Rostos e Estilos

Embora os resultados possam atingir a perfeição, é comum deparar-se com variações que mal preservam a identidade do objeto de treinamento original.

Estratégias que se mostraram eficazes:

Para obter resultados superiores, recomenda-se prolongar o treinamento aumentando o ciclo de 600 para 900 etapas, assegurando sempre que a palavra de ativação (trigger word) — como "sks person" em vez de apenas "person" — esteja incluída em seu prompt. Além disso, ao realizar a geração, ajuste a escala de orientação (CFG) para um intervalo entre 8 e 10 para maximizar a precisão e a fidelidade visual.

O desafio do erro "CUDA Out of Memory"

Desenvolvido especialmente para o público técnico, este guia aborda soluções para limitações críticas de hardware, como o esgotamento da memória VRAM de sua GPU.

Soluções rápidas:

Configure o batch size para 1 e ative o checkpointing de gradiente (flag gradient_checkpointing), utilizando a precisão mista ( mixed_precision="fp16") para otimizar o processo. Caso ocorram falhas, reduza a resolução de 1024 para 768 ou, como último recurso, utilize use_8bit_adam.

O desafio da lentidão excessiva nos processos de treinamento

A minha primeira experiência de treinamento em uma GPU 3060 demandou cerca de duas horas, um intervalo de tempo excessivo que comprometia a agilidade do processo.

Principais fatores que contribuíram para o sucesso:

Otimize sua produtividade utilizando LoRA em vez do ajuste fino completo para acelerar o processo em até cinco vezes, priorizando resoluções de 512px e um limite de 800 etapas para garantir testes rápidos e eficazes. Caso prefira máxima agilidade, invista apenas US$ 0,80 por 30 minutos de uso de uma GPU 4090 no RunPod, garantindo o melhor aproveitamento do seu tempo e investimento.

8. E quanto ao FLUX.1? Entenda as inovações deste novo modelo

Lançado em meados de 2024 pela Black Forest Labs — que reúne membros da equipe original do Stable Diffusion — o FLUX.1 superou o SDXL na maioria dos cenários, consolidando-se como uma opção superior especialmente em:

Interpretação e execução precisa de comandos complexos

A geração de textos legíveis incorporados em imagens, superando as limitações técnicas frequentemente observadas no modelo SDXL.

O nível de fotorrealismo apresenta uma evolução visível e significativa.

Eliminação de artefatos visuais e garantia de maior precisão anatômica, reduzindo falhas comuns como o excesso de dedos nas imagens geradas.

O principal desafio reside nos custos mais elevados e na exigência de hardware superior, sendo recomendados ao menos 20GB de VRAM para a operação. Enquanto plataformas como o getimg.ai já possibilitam o treinamento de modelos FLUX por valores entre 10 e 12 dólares e o Replicate expandiu recentemente seu suporte, o processamento local demanda uma GPU potente como a RTX 4090 ou a locação de infraestrutura de alto desempenho.

Vale a pena? Para demandas profissionais que exigem máxima qualidade, o investimento é indispensável, embora o SDXL continue sendo uma opção excelente para projetos pessoais e experimentações.

Considerações Finais

Em apenas dois anos, o treinamento de geradores de imagem personalizados por IA deixou de ser uma exclusividade de laboratórios de pesquisa para se tornar um projeto acessível de fim de semana, refletindo um avanço extraordinário na acessibilidade dessa tecnologia.

Confira a seguir o meu roteiro recomendado:

Comece utilizando o Replicate para treinar o seu primeiro modelo e validar se os resultados atendem às suas expectativas; caso o desempenho seja satisfatório, o processo está concluído. Contudo, se você demandar um controle mais refinado ou precisar treinar dezenas de modelos, recomendamos explorar a abordagem técnica — o segredo é não complicar, bastando iniciar com apenas 15 fotos e um investimento de 3 dólares.

Considerando que a tecnologia evolui constantemente e modelos como o FLUX.1 já superam o SDXL, novas inovações surgirão inevitavelmente em breve; por isso, em vez de esperar pela ferramenta perfeita, o ideal é começar agora mesmo com os recursos de ponta já disponíveis.

Desejamos boa sorte em sua jornada e lembramos que, assim como ocorreu em nossas primeiras experiências, o seu modelo inicial raramente será perfeito; sinta-se encorajado a prosseguir, pois o verdadeiro aprendizado é fruto da prática e da experimentação constante.

Explore as 11 principais alternativas ao Ideogram em 2026 para geração de imagens por IA, comparando modelos de preços, recursos de fotorrealismo e a diversidade de estilos artísticos disponíveis no mercado.

Explore as 11 principais alternativas ao Ideogram em 2026 para geração de imagens por IA, comparando modelos de preços, recursos de fotorrealismo e a diversidade de estilos artísticos disponíveis no mercado.

Explore nossa análise detalhada de 2026 comparando os geradores de imagens IA Ideogram e Midjourney, focada em estratégias de preços e na eficiência das ferramentas de texto para imagem. Descubra qual plataforma se destaca no design de logotipos IA com tipografia precisa, na criação de cartazes e no design visual automático, garantindo resultados superiores em artes por inteligência artificial e banners profissionais.